你有没有想过,有一天你的声音、你的脸,甚至你的身份,可能会被AI“偷走”?这不是科幻电影里的情节,而是正在发生的现实。最近,AI技术的滥用问题频频登上热搜,从恶搞视频到诈骗犯罪,AI的“双刃剑”效应越来越明显。我们不禁要问:在享受技术便利的同时,如何避免它成为犯罪的工具?又该如何划清这条伦理红线?

AI技术的“光与影”

AI技术的进步确实给我们带来了很多便利。比如,AI可以帮我们生成逼真的视频、合成自然的声音,甚至还能创作音乐和绘画。这些技术不仅让内容创作变得更高效,也为普通人提供了更多表达创意的机会。然而,技术的另一面却让人担忧。最近,一则“男孩被埋图”的新闻刷屏网络。这张图片看起来非常真实,但实际上是由AI生成的虚假内容。有人恶意将这张图与地震灾情关联,制造谣言,引发了公众的恐慌情绪。最终,涉案人员因散布谣言被依法行政拘留。

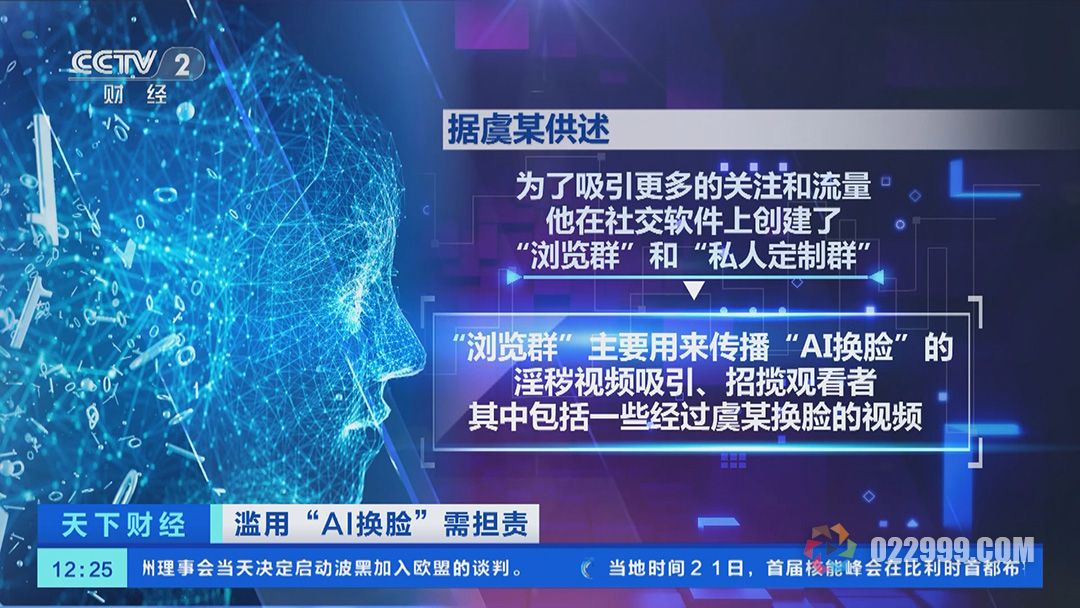

类似的事件并不少见。比如,有人利用AI换脸技术制作恶搞视频,甚至将明星的脸“移植”到不雅视频中;还有人通过AI声音克隆技术,模仿名人声音进行诈骗。这些行为不仅侵犯了他人的权益,也对社会秩序造成了严重威胁。

从恶搞到犯罪:AI滥用的“灰色地带”

AI技术的滥用往往从“恶搞”开始。比如,有人用AI生成搞笑表情包,或者制作一些无伤大雅的换脸视频。这些行为看似 harmless,但实际上已经触及了法律和伦理的底线。以AI换脸为例,虽然技术本身是中立的,但如果未经他人同意就使用其肖像,就可能构成侵权。更严重的是,一些不法分子利用AI技术进行诈骗、诽谤甚至敲诈勒索,给受害者带来了巨大的精神伤害和经济损失。

比如,2024年北京互联网法院审理了一起“AI声音侵权案”。案件中,有人未经授权使用了他人的声音样本,通过AI技术生成了虚假的音频内容。法院最终认定,这种行为侵犯了他人的声音权益,属于违法行为。

如何划清伦理红线?

面对AI技术的滥用,我们该如何划清伦理红线?首先,技术开发者需要承担更多的责任。比如,在开发AI工具时,可以加入一些限制措施,防止技术被滥用。例如,某些AI生成工具已经默认要求用户标注“AI生成”,以避免误导观众。

其次,平台也需要加强审核机制。目前,很多社交平台对AI生成内容的审核存在滞后性,导致虚假信息迅速传播。专家建议,平台可以引入人工审核机制,特别是在涉及敏感话题时,优先进行人工核查。

最后,法律法规的完善也至关重要。近年来,我国已经出台了一系列政策法规,比如《人工智能生成合成内容标识办法》和《生成式人工智能服务管理暂行办法》,为AI技术的使用划定了红线。但这些法规还需要进一步细化,明确各个环节的主体责任,确保技术不被滥用。

我们每个人的责任

除了技术开发者、平台和立法者,我们每个人也需要提高警惕。在享受AI技术带来的便利时,我们要学会辨别虚假信息,避免成为谣言传播的“帮凶”。比如,看到一些过于夸张或情绪化的内容时,可以先查证来源,或者通过反向搜索工具验证其真实性。

此外,在使用AI工具时,我们也要遵守基本的伦理规范。比如,在发布AI生成的内容时,主动标注“AI创作”,避免误导他人;在使用他人肖像或声音时,务必获得授权,尊重他人的权益。

技术无罪,使用有道

AI技术本身是中立的,它既可以造福社会,也可能被滥用。从恶搞到犯罪,AI技术的滥用问题已经引起了全社会的关注。要解决这个问题,不仅需要技术开发者、平台和立法者的共同努力,也需要我们每个人的参与。只有在技术、法律和伦理之间找到平衡,才能让AI真正成为推动社会进步的力量。

如果你对AI技术的应用和伦理问题感兴趣,可以访问凌创派官网,了解更多前沿技术和行业动态。未来的AI世界,或许就从这里开始。